En janvier 2020, une équipe d’OpenAI a publié un article au titre austère : “Scaling Laws for Neural Language Models.” L’article lui-même était truffé d’équations et de graphiques que la plupart des gens ne liront jamais.

Mais les implications étaient vertigineuses.

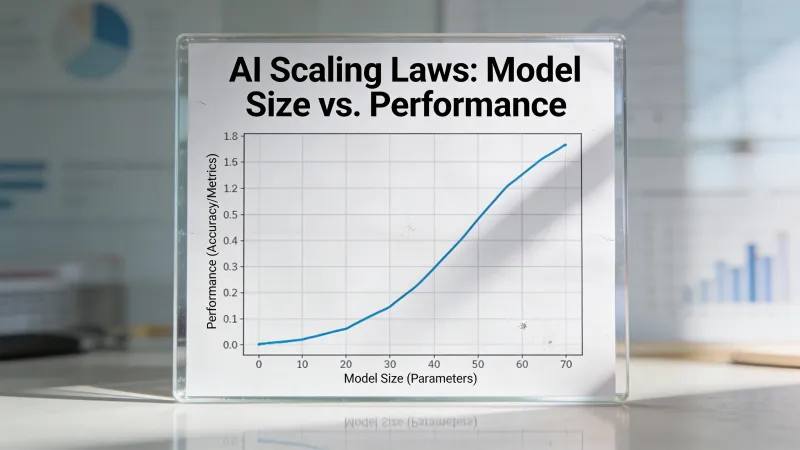

Les chercheurs, menés par Jared Kaplan, avaient mis au jour quelque chose qui semblait presque trop net pour être vrai : les performances de l’IA suivent des régularités mathématiques qui tiennent sur sept ordres de grandeur. Pas de vagues corrélations. Pas des tendances approximatives. Des lois de puissance avec des courbes prévisibles.

Cette découverte a changé la façon dont les labos d’IA opèrent, ou vont des milliards de dollars, et quels futurs semblent plausibles.

La découverte centrale

Les performances s’améliorent de manière prévisible. Cette phrase contient une affirmation extraordinaire, que l’article d’OpenAI de 2020 a réussi à étayer grâce à une expérimentation approfondie.

Les chercheurs ont entraîné des dizaines de modèles de langage de tailles différentes, sur des volumes de données différents, en utilisant des quantités de calcul différentes. Puis ils ont tracé les résultats. Ce qui en est sorti, c’est une famille de courbes lisses obéissant à des relations mathématiques précises.

Selon l’article original de Kaplan et al., “the loss scales as a power-law with model size, dataset size, and the amount of compute used for training.” Cette relation tenait pour des modèles allant de millions à des milliards de paramètres.

Vous doublez votre budget de calcul ? L’erreur de prédiction de votre modèle baisse d’une quantité constante et prévisible. Vous le redoublez ? Même amélioration proportionnelle. Les courbes restaient lisses jusqu’en haut.

Ce n’est pas comme ça que beaucoup imaginaient le fonctionnement de l’apprentissage automatique. La plupart s’attendaient à des rendements décroissants, des plateaux, des falaises imprévues où tout cesse de marcher. Au lieu de ça, les graphiques montraient une amélioration implacable, prévisible.

Pourquoi cela a tout changé

Avant les lois de mise à l’échelle, entraîner un modèle d’IA de pointe ressemblait à lancer une fusée sans savoir si vous aviez assez de carburant pour atteindre l’orbite — et vous ne le découvriez qu’à la fin d’un entraînement de plusieurs mois, qui coûtait des dizaines de millions de dollars.

Après, les labos pouvaient anticiper les résultats.

Vous voulez savoir, à peu près, de quoi sera capable votre prochain modèle ? Regardez votre budget de calcul et consultez les courbes. Vous planifiez la collecte de données ? Les lois vous disent combien il vous en faut. Vous hésitez à construire un cluster plus gros ? Vous pouvez estimer le gain de capacités.

L’IA est devenue, dans une certaine mesure, un problème d’ingénierie plutôt qu’un mystère scientifique. Pas totalement, pas complètement, mais suffisamment pour rendre des paris à plusieurs milliards de dollars gérables.

Les effets se sont propagés. Les entreprises pouvaient lever des fonds sur la base de capacités projetées. Les fabricants de matériel pouvaient estimer la demande. Les chercheurs pouvaient planifier des feuilles de route sur plusieurs années. Les lois de mise à l’échelle ont donné à tout le secteur un cadre de planification qu’il n’avait jamais eu.

La correction Chinchilla

Les premières lois de mise à l’échelle n’étaient pas tout à fait justes.

L’article de Kaplan suggérait que la taille du modèle comptait plus que la taille du jeu de données. Si votre calcul était limité, investissez-le dans un modèle plus grand. GPT-3, avec ses 175 milliards de paramètres entraînés sur “only” 300 milliards de jetons, reflétait cette philosophie.

En mars 2022, DeepMind a publié ce qu’on a fini par appeler l’article Chinchilla. Ils ont entraîné plus de 400 modèles de langage et trouvé autre chose.

L’approche optimale consistait à faire croître ensemble la taille du modèle et les données d’entraînement, à peu près proportionnellement. Leur conclusion : les modèles existants étaient sous-entraînés. Un modèle plus petit, entraîné sur davantage de données, pouvait dépasser un modèle plus gros entraîné sur moins.

Chinchilla l’a prouvé. À 70 milliards de paramètres (moins de la moitié de GPT-3) entraîné sur 1,4 billion de jetons (près de cinq fois les données de GPT-3), il égalait ou dépassait le modèle bien plus grand.

La nouvelle règle était d’environ 20 jetons par paramètre pour un entraînement optimal en calcul. Ce ratio est devenu un repère que chaque labo d’IA connaissait par cœur.

La réalité pratique de l’échelle

Des nombres comme “175 milliards de paramètres” et “1,4 billion de jetons” sont difficiles à saisir. Rendons-les concrets.

Entraîner GPT-3 a nécessité environ 3.14 x 10^23 opérations en virgule flottante. Soit 314 000,000 000,000 000,000 000 calculs individuels. L’entraînement aurait coûté, d’après certaines sources, entre 4 et 12 millions de dollars rien qu’en calcul.

Le coût d’entraînement de GPT-4 a été estimé à plus de 100 millions de dollars. Les besoins en calcul augmentent plus vite que les gains d’efficacité du matériel.

Cela crée une dynamique particulière dans l’industrie. Sur Hacker News, le commentateur bicepjai a observé : “as progress depends more on massive training runs, it becomes capital-intensive, less reproducible and more secretive; so you get a compute divide and less publication.”

Les exigences en capital filtrent ceux qui peuvent participer. Un labo universitaire ne peut pas rivaliser, à l’échelle brute, avec une entreprise capable de dépenser 100 millions de dollars sur un seul entraînement. Les lois de mise à l’échelle ont créé un monde où le progrès exige des ressources que peu possèdent.

Ce que disent les lois (et ce qu’elles ne disent pas)

Les lois de mise à l’échelle vous disent que la perte diminue de façon prévisible. La perte, ici, c’est à quel point le modèle se trompe quand il prédit le mot suivant. Une perte plus faible signifie de meilleures prédictions.

Mais voici ce que les lois ne vous disent pas : ce que le modèle sait réellement faire.

La relation entre perte et capacités est complexe. Un modèle peut s’améliorer progressivement pour prédire du texte tout en gagnant soudainement la capacité de résoudre des problèmes de maths qu’il ne savait pas résoudre avant. Ces “emergent capabilities” sont apparues à des seuils d’échelle spécifiques que les lois ne prédisaient pas.

L’apprentissage à quelques exemples (few-shot), ou un modèle apprend de nouvelles tâches à partir d’une poignée d’exemples, a émergé autour de la barre des 100 milliards de paramètres. Le raisonnement en chaîne de pensée (chain-of-thought) est apparu à des échelles similaires. Ces capacités n’étaient pas seulement des améliorations quantitatives d’aptitudes existantes. Elles étaient qualitativement nouvelles.

Les lois de mise à l’échelle décrivent une courbe lisse. La réalité a montré des sauts brusques.

Le problème de recherche ouvert

Tout le monde n’a pas célébré le paradigme de la mise à l’échelle.

Sur Hacker News, le chercheur gdiamos a commenté : “I especially agree with your point that scaling laws really killed open research. That’s a shame and I personally think we could benefit from more research.”

La préoccupation est structurelle. Si le progrès exige du calcul massif, seuls des labos très financés peuvent avancer. Si seuls des labos très financés avancent, la plupart des chercheurs ne peuvent pas contribuer à la frontière. Les départements d’informatique universitaires — historiquement la source d’idées de rupture — sont relégués sur le côté.

gdiamos a continué : “If scaling is predictable, then you don’t need to do most experiments at very large scale. However, that doesn’t seem to stop researchers from starting there.”

Il y a quelque chose d’ironique là-dedans. Théoriquement, les lois de mise à l’échelle vous permettent de prédire des résultats à grande échelle à partir d’expériences à petite échelle. En pratique, les incitations poussent tout le monde vers l’échelle, quand même. Vous ne pouvez pas publier sur des capacités de type GPT-5 si vous n’avez pas de ressources de type GPT-5.

Au-delà du pré-entraînement : de nouvelles frontières

Les lois de mise à l’échelle originelles se concentraient sur le pré-entraînement, la phase initiale où un modèle apprend à prédire du texte. Mais la chaîne de développement de l’IA comporte d’autres étapes.

Des travaux récents ont identifié au moins trois régimes de mise à l’échelle distincts :

Mise à l’échelle du pré-entraînement : suit les lois originales de Kaplan et de Chinchilla. Des modèles plus grands, entraînés sur plus de données, prédisent mieux le texte.

Mise à l’échelle du post-entraînement : couvre l’affinage (fine-tuning) et l’alignement. La relation entre le calcul dépensé sur le retour humain et le comportement du modèle suit ses propres régularités, distinctes du pré-entraînement.

Mise à l’échelle à l’inférence : la découverte la plus récente. Le modèle o1 d’OpenAI a montré que laisser un modèle “think longer” au moment de l’inférence améliore les performances de raisonnement. Cela suggère une autre dimension où plus de calcul donne de meilleurs résultats.

L’existence de plusieurs lois de mise à l’échelle implique des voies d’amélioration continues même si la mise à l’échelle du pré-entraînement ralentit. Un modèle peut potentiellement devenir meilleur via un post-entraînement plus sophistiqué, ou en prenant plus de temps pour raisonner sur les problèmes.

Le mur des données

La correction Chinchilla a créé un nouveau problème.

Si un entraînement optimal exige d’augmenter les données en même temps que la taille du modèle, et si les modèles de pointe ont déjà consommé la plupart des textes de haute qualité sur internet, d’où viendra le prochain jeu de données d’entraînement ?

Des estimations suggèrent que le web indexé contient environ 510 billions de jetons. Ça paraît énorme jusqu’à ce que vous réalisiez que la plupart est de faible qualité, répétitif, ou carrément du déchet. Le texte de plus haute qualité — celui qui apprend réellement à un modèle à bien raisonner — n’en représente qu’une petite fraction.

Les approches actuelles face au mur des données incluent :

Données synthétiques : faire générer à l’IA les données d’entraînement de la prochaine génération d’IA. Cela fonctionne dans une certaine mesure, mais cela comporte des risques d’effondrement du modèle si c’est fait sans précaution.

Expansion multimodale : entraîner sur des images, de la vidéo et de l’audio, en plus du texte, ouvre de nouvelles sources de données. Le monde contient bien plus d’information visuelle que de texte écrit.

Curation de plus haute qualité : peut-être que le problème n’est pas la quantité mais la qualité. Un meilleur filtrage pourrait extraire davantage de signal d’apprentissage à partir des données existantes.

Création de nouvelles données : certains labos paieraient pour, ou créeraient, du contenu propriétaire spécifiquement pour l’entraînement.

Aucune de ces approches ne résout clairement le problème. Le mur des données reste l’une des contraintes centrales sur la poursuite de la mise à l’échelle.

Le débat sur les rendements décroissants

Fin 2024 et tout au long de 2025, des informations ont commencé à circuler selon lesquelles les améliorations des modèles de pointe ralentissaient. Les derniers modèles ne faisaient plus de bonds aussi spectaculaires que les générations précédentes.

Certains y ont vu la mort de la mise à l’échelle. La fête était finie. Les lois avaient épuisé leur pouvoir.

D’autres ont rappelé que les lois de mise à l’échelle originelles prédisaient des rendements décroissants dès le départ. Les courbes sont logarithmiques, pas exponentielles. Chaque doublement du calcul achète une amélioration absolue plus petite que le précédent. C’était toujours le schéma attendu.

Le débat se joue sur une question à laquelle personne ne peut répondre de manière définitive : observe-t-on le ralentissement attendu d’une amélioration logarithmique, ou un plafond fondamental de ce que la mise à l’échelle peut produire ?

Différents observateurs lisent les mêmes données différemment. Le progrès continue, mais à quel rythme ? Et ce rythme suffit-il pour les capacités que les gens veulent ?

Les prédictions qui se sont vérifiées (et celles qui non)

Les lois de mise à l’échelle ont fait des prédictions spécifiques. Certaines ont tenu. D’autres non.

Vérifié : la relation de base entre calcul et perte est restée remarquablement cohérente à travers différentes architectures et approches. Les courbes fondamentales fonctionnent.

Partiellement vérifié : le ratio optimal de Chinchilla s’est révélé optimal pour l’efficacité d’entraînement, mais pas pour l’efficacité en production. Des modèles modernes comme Llama 3 s’entraînent sur 200 jetons par paramètre, bien au-delà de l’optimum Chinchilla, parce que les coûts d’inférence comptent plus que les coûts d’entraînement pour des produits utilisés à grande échelle.

Ne s’est pas vérifié : la prédiction de l’article original de Kaplan selon laquelle la taille du modèle compte plus que la taille des données était tout simplement fausse. Chinchilla l’a démontré de manière décisive.

Incertain : savoir si la mise à l’échelle continue de produire des capacités utiles au-delà des échelles actuelles reste non résolu. Les lois prédisent une baisse continue de la perte, mais pas si cette baisse se traduit en capacités qui importent aux humains.

Ce que la mise à l’échelle ne peut pas vous dire

Les lois de mise à l’échelle restent muettes sur plusieurs questions critiques.

Elles ne vous disent pas si un modèle va halluciner. Réduire la perte ne garantit pas l’exactitude factuelle.

Elles ne vous disent pas si un modèle sera sûr, ni s’il sera aligné sur des valeurs humaines. Un modèle peut prédire du texte très correctement tout en étant utile, inoffensif, ou dangereux.

Elles ne vous disent pas si un modèle sera bon sur une tâche spécifique. Réduire la perte de façon générale ne garantit pas des performances sur le problème particulier qui vous intéresse.

Elles ne vous disent pas quand des capacités qualitativement nouvelles émergeront. Les lois décrivent des courbes lisses, mais les capacités apparaissent de façon discontinue.

Ces trous comptent. Ils signifient que même avec une connaissance parfaite des lois de mise à l’échelle, vous ne pouvez pas prévoir entièrement à quoi ressemblera un modèle. Les lois contraignent l’espace des possibles sans le déterminer.

L’énigme philosophique

Il y a quelque chose d’étrange, philosophiquement, dans les lois de mise à l’échelle.

Pourquoi la prédiction du langage suivrait-elle des schémas mathématiques aussi propres ? Les données d’entraînement sont un instantané sale et incohérent de l’écriture humaine. L’architecture est une suite de choix d’ingénierie. Le processus d’optimisation est stochastique. Et pourtant, le résultat suit des lois de puissance sur sept ordres de grandeur.

Certains y voient la preuve que l’intelligence a une structure mathématique qui attend d’être découverte. D’autres y voient une coïncidence suspecte qui pourrait ne pas durer éternellement. D’autres encore soutiennent que cela reflète simplement les propriétés statistiques du langage lui-même.

Les lois de mise à l’échelle fonctionnent. La raison pour laquelle elles fonctionnent reste réellement obscure.

Où cela nous laisse

Les lois de mise à l’échelle ont offert à l’industrie de l’IA quelque chose dont elle avait désespérément besoin : un cadre de planification. Elles ont permis des investissements à plusieurs milliards, des feuilles de route sur plusieurs années, et des prédictions confiantes sur des capacités futures.

Mais les cadres peuvent devenir des prisons.

L’obsession de la mise à l’échelle a peut-être étouffé d’autres approches. Le calcul massif est devenu la solution par défaut, même quand des expériences plus petites auraient pu répondre aux mêmes questions. La recherche académique a été marginalisée. Les architectures alternatives ont reçu moins d’attention.

Aujourd’hui, alors que la mise à l’échelle du pré-entraînement montre des signes de tension, l’industrie découvre d’autres chemins. La mise à l’échelle à l’inférence. Les données synthétiques. De meilleurs algorithmes d’entraînement. L’optimisation après entraînement. Ces approches existaient depuis le début, mais vivaient dans l’ombre de l’échelle.

Les lois de mise à l’échelle ont été une découverte sur la façon dont l’IA fonctionne. Elles ont aussi été un choix sur la façon de poursuivre le progrès. Savoir si ce choix était optimal, si nous serions plus avancés aujourd’hui avec des approches plus diverses, est une question à laquelle personne ne peut répondre avec certitude.

Ce que nous savons : les courbes descendent toujours. Le calcul aide toujours. Les lois tiennent toujours, même si les gains deviennent plus difficiles à capturer.

La prochaine percée viendra peut-être de plus d’échelle — ou de quelque chose d’autre, entièrement.